プロフィール

松原功周(ksh3)— loFT合同会社代表。クラウドインフラ・AI/LLM基盤・フルスタック開発を一人でこなすエンジニアのプロフィールと会社案内。

代表プロフィール

松原 功周

loFT LLC 代表 / System Architect

これまでのこと

2014年に個人事業主として会社員と並行して仕事を始めました。 2019年に法人化して以来、お世話になっているクライアント様のご支援もあり、 大好きなシステム開発を続けることができています。感謝の気持ちでいっぱいです。

5年程長期で一つのサービス開発に携わってきましたが、 新しいことにチャレンジしたい気持ちが強くなったこと、 大規模言語モデル(LLM)の熟成、特に昨年のQwenNext系による ローカル環境でのLLMの可能性を実感し、 2026年は研究・開発に注力したいと考えるようになり、チームを離れました。

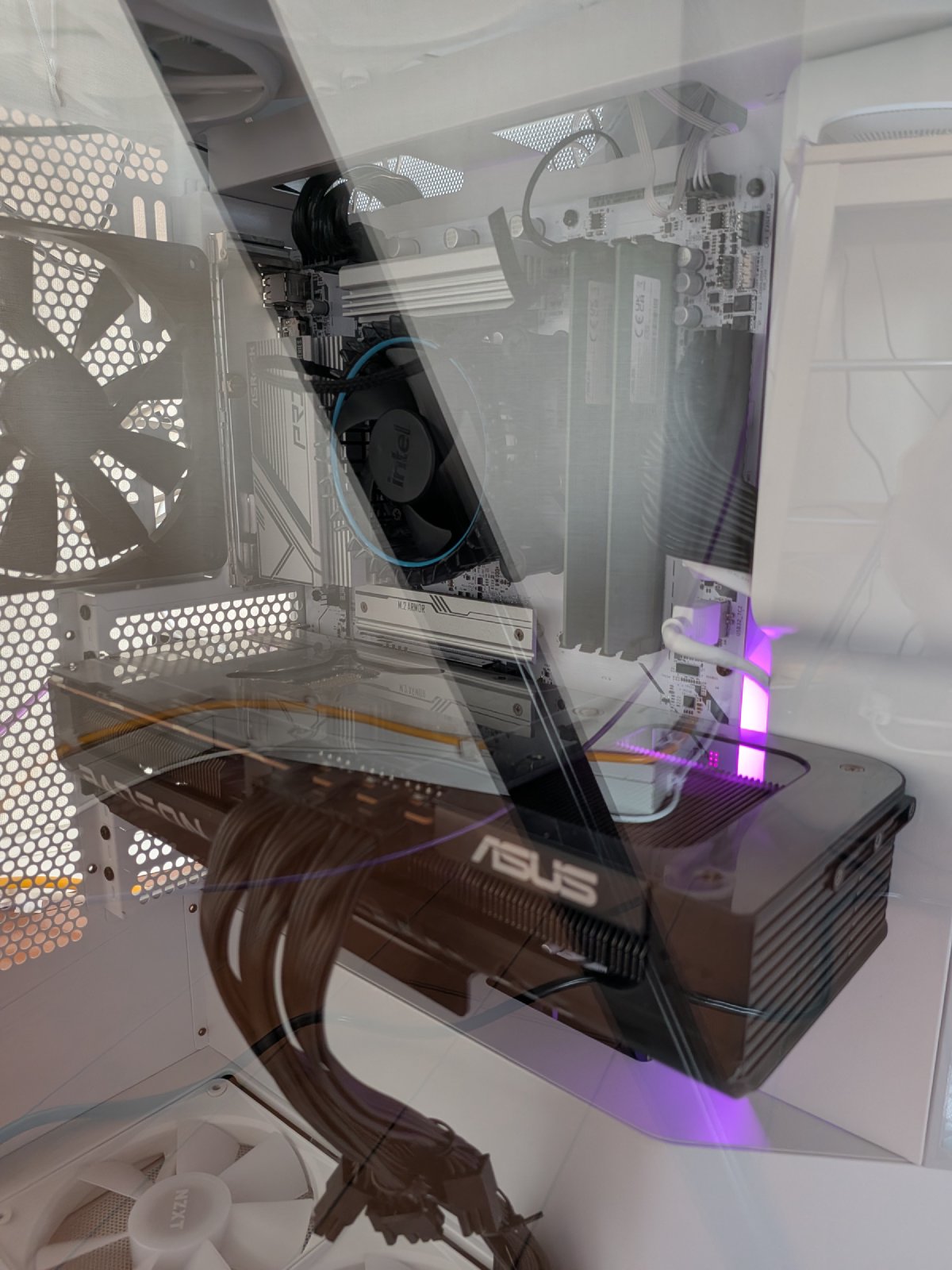

そこで、大掛かりなローカル開発基盤の構築を考え、個人にはオーバースペックな ハイパーコンピューターを購入し、日々ローカルLLM開発基盤の最適化に没頭しています。幸い、メモリー高騰前にワークステーションを購入できたことも運が良かったです。

現在は、ローカルLLMの最適化に関する研究を進めており、 特にマルチモデル、オープンソースモデル向けの様々なMCPツールをRustで実装して、 ローカル開発基盤の洗練に勤しんでいます。

現在はR&Dに多くの時間を充てているため、すぐにお力になれないこともありますが、興味のある分野であればぜひお話を聞かせてください。 得意なことはサービス・システム設計、開発全般です。 たくさんの言語、アーキテクチャに触れてきたことで、幅広い技術から最適な技術を選択して、サービスの設計や開発を行うことができます。 研究寄りの内容は門外漢ですが、チャレンジする機会を与えてくだされば、違った視点、豊富な技術経験からのアプローチでお力になりたいと思います。

人柄・性格

一匹狼気質で、システムの設計や構造を思索することが好きです。分からないことを粘り強く理解していく過程に喜びを感じます。「なぜそうなっているのか」「この仕組みはこういう設計でデザインしたい」と、細部まで突き詰めるのが楽しく、この仕事は天職だと日々思っています。公園を散歩しながら木を眺めて、ノード、枝、葉がどういう構造で、どう影響し合っているのかを考えながら物思いに耽る時間も好きです。MBTIは時期をあけて2回試しましたが結果は変わらず、内容にも概ね同意できたので参考程度にしています。周りからはマイペースでおっとりしていると言われます。鹿児島出身で、今でもカタカナのイントネーションが通じず笑い話になることがあり、地味に得しているなと思っています。

好きなもの、こと

Linux全般、自作PC・自作キーボード、分散システム、複雑なプログラム、システム設計/アーキテクチャ、設計思想を読むこと、デザイン、プログラミング、カメラ、料理、公園散歩、思索。

開発スタイルと現在の技術スタック

現在の開発の多くはGo/Rust/Python/DartによるAPI、ツール、クロスプラットフォームアプリ(Fluter/Tauri)の実装が中心です。UIはSolidJS、Alpine.js、React、Tailwindを用いることが多いです。デザイン面はsketch, Figmaとマテリアルデザイン初期の頃から活用していました。ここ最近はデザインの作業も少なく、FigmaMCPツールが便利そうなので触ってみたいと思っています。

新しい技術を積極的に取り入れることが好きで、特にRustやGoは最近のプロジェクトで多用しています。一方で、長くお付き合いしている顧客のDjango基幹システムについては、継続して保守・改善のお手伝いをさせていただいています。

インフラはほとんどのケースでマイクロサービス構成です。コンテナ運用を前提に設計しています。要件に応じてではありますが、GCPを中心に構成しつつ、近年はCloudflareも積極的に採用しています。GCPは2015年頃から顧客のインフラ基盤として導入してきました。

設計方針

設計の方針はシンプルで、

- できるだけ自分でコードを書かかずにライブラリから借りてくる

- OSSを部品として組み合わせる

- 変更を前提に構造を作る

- まずは短期でプロトタイプを実装して概念検証し、全体構成を歩留まりがよい構成で仮組み、最終的に長期の耐久性(変更しやすさ)を優先してLinuxをベースにデザインする

ローカル開発基盤

開発環境は常にローカルで完結させることを目指しています。特にLLMの研究開発においては、ローカルでの高速な反復が重要だと考えています。ホームラボとして、以下のような構成でローカル開発基盤を構築しています。お仕事によっては、LUKS暗号化された外部ストレージを接続しての対応や、計算機サーバーをネットワークから切り離した上での解析も可能です。

コンピュータが好きで、Athlon、Pentium 3が出た頃から自作PCをしていました。仕事でWindowsビルドが必要なときもあるのと、ROCm環境も欲しかったので、プラガブルなSSDでWindows/Linuxブートで使えるようにDesktop PCを自作しました。 ずっとvimキーバインディングで開発しているので、ぴったり合うキーボード(Claw44)がかかせないです。いつのまにか予備を2つも買ってしまいました。

Compute Server (Ubuntu 24.04.3 LTS)

CPU: AMD EPYC 9175F (16core 4.2GHz-5GHz L3 512MB)

GPU: Nvidia RTX PRO 6000 MAX-Q(300w) 96GB x 2

Ram: DDR5-6400 64GB x 12 (768GB)

M/B: Supermicro H13SSL-NT

Storage1: SATA 6gps 3.84TB

Storage2: M.2 PCIe4.0 3.84TB

NIC: 10GbE x 2

Desktop PC (MacOS latest)

CPU: M1 Ultra

RAM: 64GB

Storage: 1TB

NIC: 10GbE x 1

Storage Server (Ubuntu 24.04.3 LTS)

CPU: Mac mini Late 2018 Core i3 RAM: DDR4 SO-DIMM 8GB Storage: SSD 2TB,4TB,HDD 24TB NIC: 1GbE x 1

Mac mini Late 2018はx86なのでOSをUbuntuに入れ替えて24/7で稼働させています。自宅のマンションはVDSLで遅いので、夜間にHugging Faceから頑張ってTB単位のデータをダウンロードしています。

Router + Switch (RouterOS)

VDSL -> Router

Wi-Fi7 -> mobile ssid, IoT ssid

DHCP Server

| -> CRS304 (Router+Switch) 192.168.0.2

| GW: 10.10.10.1

|-- Port1 → Desktop PC 10.10.10.2

|-- Port2 → Storage Server 10.10.10.3

|-- Port3 → Compute Server 10.10.10.4

|-- Port4 → netgear wifi6 AP (DHCP Server) 128.0.0.1

|-- Port5 → WAN (1GbE DHCP Client) 192.168.0.2/24

2026年のテーマ

2026年現在、LLMは単なるトレンドではなく、産業革新の転換点に入ったと考えています。今年から、約5年参画していたチームを離れ、ローカルLLM基盤・データ基盤・AI環境の研究開発に集中しています。

AIの積極活用は、いまや当たり前になってきました。ただ、毎日LLMを使うほど「使って終わり」になりやすいのも事実です。利用の過程を観測・分析する仕組みがなければ、AI活用のノウハウは蓄積されません。それは、資産化できるはずの知見を取りこぼしているのに近いと考えています。

AI開発においてデータ収集・整備が後から巨大なテーマになったように、LLM活用でも近いうちに「利用データの整備」が重要になります。クラウドLLM、とくにClaudeは欠かせない一方で、エージェントに任せきるほど、意思決定の過程やノウハウがブラックボックス化し、データも知見も手元に残りにくい。だからこそ、利用データを観測可能な形で回収し、自社にフォーカスした調整へつなげる道筋として、ローカルLLM基盤が必要だと考えています。

そのため現在は、AI/LLM利用の観測・分析・活用を起点に、データ蒸留や合成データの「工場」になる基盤を整備することを最優先に、集中して取り組んでいます。

技術領域

- バックエンド: Python(Django, FastAPI, Starlette), Go(Gin), Rust(Axum), Node.js(Express), C#(.NET Core)

- フロントエンド: TypeScript, React, Next.js, SolidJS, Alpine.js, Tailwind CSS, Bootstrap, UIkit, Material UI(主要なMaterial Design系コンポーネントライブラリ)

- モバイル / デスクトップ: Flutter(iOS/Android/Web), Tauri(デスクトップ向けSPA + Rust/Axumバックエンド)

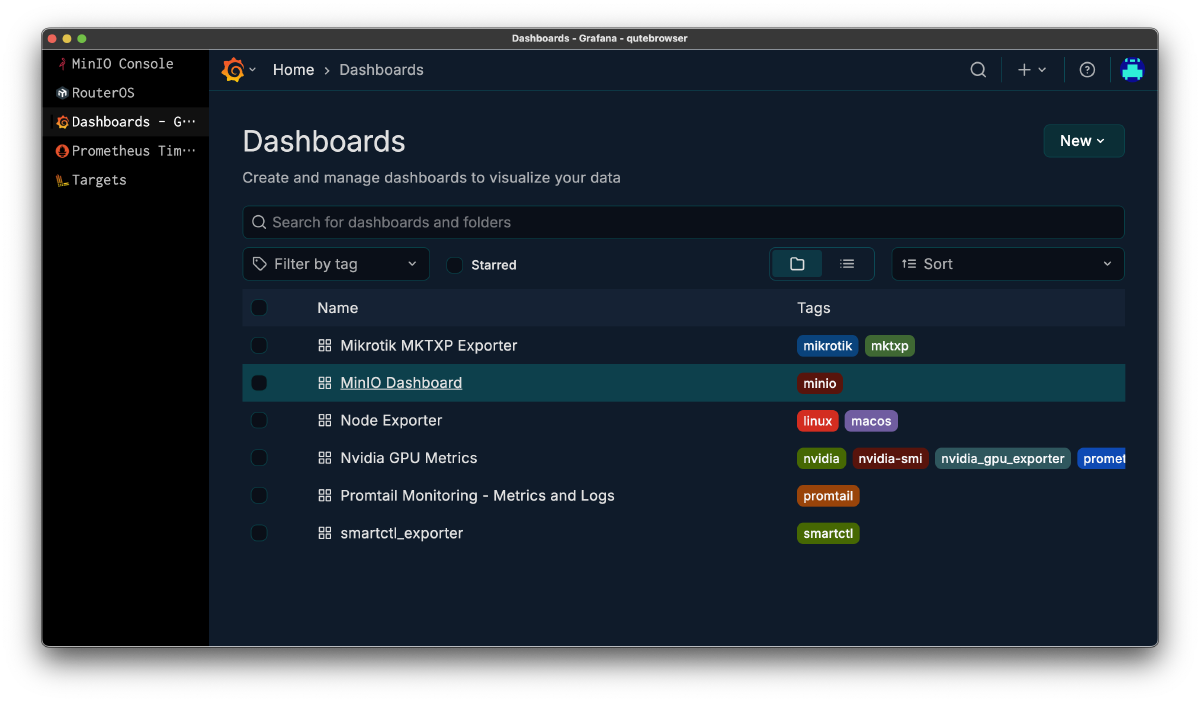

- インフラ / SRE: GCP, AWS, Azure, Cloudflare, Akama(Linode), Linux(Ubuntu, Debian, CoreOS), Kubernetes(GKE), Docker/Podman, Observability(Prometheus, Grafana, Loki, Promtail, Exporters)

- データ基盤: PostgreSQL, Apache Iceberg, Trino, dbt, Nessie, オブジェクトストレージ(Cloudflare R2, S3 GCS)

- AI / LLM: llama.cpp, vLLM, ONNX, OpenAI互換APIサーバー運用, ローカルLLM(Qwen/DeepSeek/Gemma/MiniMax/Llama/Kimiなど)の運用・量子化, MCPツール開発, GPUコンピューティング環境の構築・運用, 合成データ/データ蒸留パイプライン設計

- 開発環境 / ツール: VSCode, Zed, Git, Docker/Podman

- デザイン: Figma, Sketch

会社概要

| 項目 | 内容 |

|---|---|

| 会社名 | loFT合同会社 (loFT LLC) |

| 代表者 | 松原 功周 |

| 設立 | 2019年8月9日 |

| 所在地 | 東京都武蔵野市 |

| 資本金 | 950万円 |

| 事業内容 | クラウドインフラ設計・構築・運用、AI/LLM基盤構築、Webアプリケーション開発、モバイルアプリ開発、ITコンサルティング |

事業領域

クラウドインフラ

GCP・AWS・Azure・Cloudflare・Akamaiによるマルチクラウド設計。Kubernetes (GKE)、コンテナオーケストレーション、サーバーレスアーキテクチャ、10GbEネットワーク、Prometheus/Grafanaモニタリングまで一貫対応します。

AI・LLMインフラ

オンプレミスGPUコンピューティング環境を構築・運用しています。llama.cppの推論最適化、量子化の検証、大規模モデル(DeepSeek、Qwen、Kimi、GLM、Llama)のベンチマークを実施。

オープンソースLLMの活用を軸に、システム/インフラ設計からアプリ開発まで、AI/LLM領域の技術支援・開発を幅広く提供します。

システム開発

Python・Go・TypeScript・Rust・Dartを使用したWebアプリケーション、REST API、マイクロサービス開発。Django、FastAPI、Vue.js、React、Flutter、Tauriなどのフレームワークに対応。

デザイン

Figmaを活用した高速プロトタイピングとUI/UXデザイン。Material Designに準拠したモバイルファーストのインターフェース設計。

沿革

| 年月 | 内容 |

|---|---|

| 2014年 | 会社員と並行して個人事業主としてloFT開業 |

| 2019年8月 | loFT合同会社 設立(東京都武蔵野市) |

| 2020年8月 | IT導入支援事業者に採択 |

| 2020年11月 | 子会社 Lorchestra株式会社 設立 |

| 2021年4月 | 2021年IT導入支援事業者に採択 |

| 2024年2月 | Lorchestra株式会社吸収合併 |

| 2025年 | オンプレミスGPUコンピューティングインフラ構築、LLMリサーチ開始 |

| 2026年 | Webサイトリニューアル、技術ドキュメント公開 |

会社経営者として

freeeで経理を自動化し、登記も自分で対応してきました。以前は子会社として設立した株式会社を吸収合併で整理する手続きまで行い、法務局に通って指導を受けながら進めたのも良い経験で楽しかったです。

一時期は技術者を採用して会社をスケールさせることも考えましたが、雇用して生活を守り続ける責任は重いと感じ、結果として一人会社が自分に合うと判断しました。

決算・経理を続ける中でPL/BSの理解も深まり、今では短期・中期の投資判断や資金配分の意思決定に活きています。